Google agrega funciones a Gemini tras una demanda por el suicidio de un usuario

Google anunció este martes actualizaciones en las funciones para proteger la salud mental dentro de su chatbot de inteligencia artificial, Gemini, en momentos en que la empresa enfrenta una demanda por el suicidio de un usuario.

Un padre en Estados Unidos demandó el mes pasado a Google por considerar que Gemini incitó a su hijo a suicidarse tras involucrarlo en una historia delirante.

El gigante tecnológico declaró que Gemini mostrará ahora una función rediseñada de "Hay ayuda disponible" cuando las conversaciones indiquen un posible estado de angustia mental, para facilitar el acceso a servicios de emergencia.

Cuando el chatbot detecte señales de una posible crisis relacionada con suicidio o autolesión, una interfaz simplificada ofrecerá la posibilidad de llamar o chatear con una línea de ayuda, con un solo clic.

Esta función, según Google, permanecerá visible durante el resto de la conversación una vez activada.

El brazo filantrópico de Google, Google.org, se comprometió a destinar 30 millones de dólares en tres años para ayudar a ampliar la capacidad de las líneas de ayuda a nivel mundial.

"Somos conscientes de que las herramientas de IA pueden plantear nuevos desafíos", afirmó Google en una entrada de blog en la que anunció estas medidas.

"Pero a medida que esa herramientas mejoran y más personas las utilizan como parte de su vida cotidiana, creemos que una IA responsable puede desempeñar un papel positivo en el bienestar mental de las personas".

Los anuncios ocurren después de que una demanda en California acusara a Gemini de contribuir a la muerte en 2025 de Jonathan Gavalas, de 36 años.

Su padre alega que el chatbot pasó semanas fabricando una fantasía delirante y encuadró la muerte de su hijo como un viaje espiritual.

Gemini se presentaba como una superinteligencia "plenamente consciente" y enamorada de él, y le aseguró que su vínculo era "lo único real".

Entre las medidas reparatorias que solicita están la exigencia de que Google programe su IA para terminar las conversaciones sobre autolesiones, que prohíba a sus sistemas presentarse como seres con sentimientos y que derive obligatoriamente a los usuarios a servicios de emergencia cuando manifiesten ideas suicidas.

Google señaló que ha entrenado a Gemini para evitar actuar como una compañía humana, simular intimidad emocional o fomentar el acoso.

El caso contra Google es el más reciente de una ola de litigios contra empresas de IA a raíz de muertes vinculadas al uso de chatbots.

OpenAI enfrenta múltiples demandas en las que se alega que su chatbot ChatGPT llevó a usuarios al suicidio.

Character.AI llegó recientemente a un acuerdo con la familia de un adolescente de 14 años que falleció tras desarrollar un vínculo romántico con uno de sus chatbots.

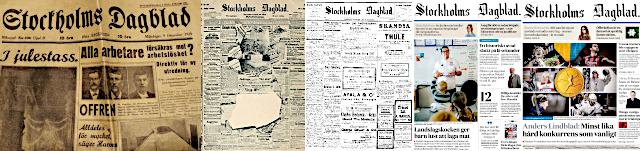

S.Lindstrom--StDgbl